Des textes, des voix et des images fabriqués à très bas coût : l’intelligence artificielle (IA) change déjà l’échelle et la vitesse de la propagande en Afrique. À l’approche d’importants scrutins, des réseaux structurés, locaux et étrangers, exploitent ces outils pour manipuler l’opinion, intimider la presse et brouiller le débat public. Les enquêtes sur « African Initiative » illustrent cette bascule.

Comment l’IA change l’échelle et la vitesse de la propagande

L’IA générative permet de produire en quelques minutes des lots de contenus persuasifs : articles, visuels, voix clonées, vidéos courtes et de les diffuser massivement via des fermes à contenus et des bots. Les coûts baissent, la cadence s’accélère et les mêmes récits peuvent être adaptés à plusieurs publics linguistiques en quelques clics. Cette industrialisation s’accompagne d’un ciblage plus fin : sur les réseaux sociaux, l’optimisation publicitaire et les recommandations algorithmiques servent de carburant à des récits polarisants. Des experts expliquent que la désinformation “assistée IA” devient un outil structurant des campagnes d’influence ; on sape la confiance dans les autorités électorales, on normalise les “cheap fakes”, puis on occupe l’attention avec des formats courts faciles à partager. Dans ce contexte, la frontière entre militantisme, propagande et harcèlement orchestré s’efface progressivement.

Une autre mutation gagne en importance au même moment : l’usurpation de l’identité journalistique. L’émergence de “faux journalistes”, avatars, biographies et photos de profil générés par IA offre une façade professionnelle à des contenus partisans. L’outillage IA confère ainsi une apparence de crédibilité à des récits fabriqués tout en brouillant les repères du public sur qui parle, au nom de qui et avec quelle responsabilité.

Acteurs, relais et méthodes : l’écosystème pro-russe en Afrique

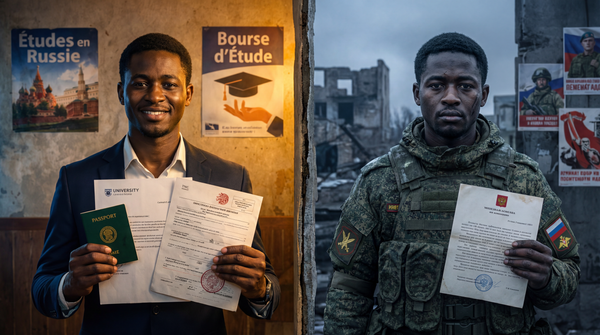

Parmi les dispositifs mis en avant par plusieurs enquêtes figure « African Initiative ». Présentée comme un média axé sur l’Afrique, la structure diffuse des contenus en plusieurs langues et active des canaux comme Telegram, Facebook et TikTok. Selon des rapports publics et des articles d’investigation, « African Initiative » s’inscrit dans une stratégie d’influence pro-russe visant les publics africains, en particulier francophones. Des révélations relayées par des médias européens et africains ont mis en évidence des méthodes d’habillage médiatique soigné, des relais locaux et une saturation de l’espace informationnel par des narratifs favorables à Moscou et hostiles à ses rivaux. Cette dynamique n’est pas isolée. D’autres réseaux pro-étatiques testent en Afrique des formats et des méthodes similaires, allant du doublage IA pour localiser rapidement des vidéos à l’usage d’images hyper-réalistes pour susciter l’émotion, en passant par le recyclage de dépêches “neutres” agrémentées de commentaires biaisés. À mesure que ces tactiques se déploient, elles rencontrent des fragilités structurelles : inégalités d’accès à l’information fiable, pressions politiques sur la presse et dépendance aux plateformes pour la distribution des nouvelles. Dans ce terreau, rappelle UPAfrica Media, les réseaux sociaux élargissent certes l’espace public, mais ils exposent aussi davantage les journalistes aux menaces et aux campagnes de discrédit, ce qui facilite encore la diffusion de récits artificiels.

Conséquences démocratiques : élections, confiance publique et violences genrées

Les effets se lisent d’abord dans les moments électoraux. À l’approche d’un scrutin, quelques fausses déclarations virales, une vidéo trafiquée ou un audio cloné suffisent à semer le doute sur l’intégrité des candidats ou de la commission électorale. Les heures qui précèdent le vote sont particulièrement critiques, car la capacité de réponse est limitée et un mensonge bien ciblé peut faire basculer des intentions. Au-delà du vote, la répétition de récits contradictoires, d’images “trop parfaites” et d’arguments émotionnels érode peu à peu la confiance dans les institutions, dans les médias et, plus largement, entre citoyens. L’objectif recherché est constant : saturer l’attention, rendre la vérité difficile à distinguer et installer le soupçon comme réflexe. À cela s’ajoute une dimension de sécurité trop souvent sous-estimée. L’IA sert en effet à produire des contenus humiliants ou sexualisés destinés à harceler des journalistes et des militantes. Montages, voix clonées et images détournées entretiennent un climat d’intimidation qui réduit la participation de certaines voix, en particulier celles des femmes, au débat public. L’espace commun devient plus bruyant, plus hostile à la contradiction et, au final, moins démocratique.

Contre-mesures : priorités et leviers d’action

Pour contenir cette vague, la première réponse tient à la transparence et à la traçabilité. Les plateformes doivent étendre le marquage des contenus synthétiques, images, sons et vidéos et ouvrir davantage leurs données aux chercheurs africains. Les missions d’observation électorale, de leur côté, gagneraient à intégrer des protocoles de détection des deepfakes audio et des avatars de “faux journalistes”, afin de traiter rapidement les incidents informationnels. En parallèle, l’écosystème de vérification mérite d’être armé d’outils défensifs : détection de synthèse vocale, recherche inversée d’images et méthodes de traçage des origines. La formation éditoriale reste essentielle pour éviter l’amplification involontaire ; elle doit s’accompagner d’une pédagogie grand public sur les signaux d’alerte, qu’il s’agisse de styles d’écriture uniformisés, de voix artificielles, d’incohérences visuelles ou de pages fraîchement créées sans empreinte professionnelle vérifiable.

Toutefois, la technologie ne suffira pas sans un socle d’intégrité médiatique locale. La crédibilité des rédactions ouest-africaines demeure la meilleure barrière aux récits fabriqués. Des chartes d’usage de l’IA fondées sur la traçabilité des contenus générés et l’interdiction de la dissimulation peuvent consolider ce socle, à condition d’être accompagnées de formations et de coopérations transfrontalières pour suivre les narratifs (notamment ceux relayés par « African Initiative ») et identifier les grappes de comptes amplificateurs. Enfin, l’éducation aux médias doit aller de pair avec une meilleure protection des cibles. Former élèves, électeurs, leaders communautaires et agents publics à reconnaître les signatures de la génération synthétique constitue une priorité ; protéger spécifiquement les femmes journalistes et militantes, davantage visées par des contenus d’abus assistés par IA, en est une autre. Lorsque des campagnes coordonnées apparaissent, une assistance rapide (juridique, technique et psychologique) aide à réduire les dommages.

La coopération internationale vient compléter cet arsenal. Face à des opérations transnationales, l’échange de renseignements techniques sur les réseaux de diffusion et les “empreintes” des modèles, la publication régulière de bulletins d’ingérence et le soutien à des initiatives ouvertes de surveillance des plateformes créent un effet dissuasif. Les révélations publiques autour d’« African Initiative » montrent l’intérêt d’analyses transparentes qui exposent méthodes, relais et objectifs, tout en respectant la liberté d’informer.

La propagande n’est pas nouvelle en Afrique, mais l’IA lui donne une vitesse, une échelle et une vraisemblance inédites. Documenter les réseaux, à commencer par « African Initiative », protéger la presse et muscler la résilience citoyenne deviennent des priorités démocratiques. Sans ces garde-fous, les prochaines campagnes électorales risquent d’être écrites, et biaisées, par des algorithmes.